AI에게 질문을 하면 이제는 꽤 그럴듯한 답을 해줍니다. 그런데 가끔은 이런 생각이 들 때가 있습니다. “왜 이렇게 간단한 문제를 틀리지?”, “조금만 더 생각하면 맞힐 수 있을 것 같은데”. 이 질문에서 출발하는 개념이 바로 추론 프롬프팅(Reasoning Prompting)입니다.

이번 포스팅에서는 AI에게 정답을 바로 말하라고 요구하는 방식이 아니라, 어떻게 생각하게 할 것인가를 설계하는 방법을 다룹니다.

특히 최근 많이 언급되는 네 가지 개념인 CoT, ToT, GoT, 그리고 Test-time Scaling(몬테카를로 방식의 추론 확장)을 중심으로 살펴봅니다.

초기의 프롬프트는 단순했습니다. “이 문장을 요약해줘”, “이 문제의 정답을 알려줘”처럼 AI에게 결과만 요청하는 방식이었죠.

하지만 문제의 난이도가 올라갈수록 이런 접근에는 분명한 한계가 드러났습니다. 사람과 마찬가지로 AI 역시 복잡한 문제를 풀기 위해서는 중간 사고 과정이 필요하기 때문입니다.

이러한 배경에서 등장한 것이 추론 프롬프팅입니다.

정답만 요구하는 대신, AI가 어떤 과정을 거쳐 답에 도달하도록 할 것인지를 설계하는 방식입니다.

이 아이디어의 출발점이 바로 CoT, 즉 Chain of Thought입니다.

Chain of Thought : 생각 과정을 한 줄씩 따라가게 하기

Chain of Thought는 말 그대로 AI에게 생각의 사슬을 만들도록 유도하는 방식입니다.

“이 문제를 단계별로 생각해서 답해줘”와 같은 프롬프트를 사용하면, AI는 바로 정답을 내놓는 대신 1단계, 2단계, 3단계 식으로 사고 과정을 풀어내기 시작합니다. 이는 사람이 수학 문제를 풀 때 풀이 과정을 적는 방식과 유사합니다.

CoT가 효과적인 이유는 AI가 한 번에 정답을 맞히는 데는 상대적으로 약한 반면, 작은 단계를 차례로 밟는 데에는 강하기 때문입니다. 문제를 여러 단계로 나누면 중간에서 오류를 점검할 수 있고, 복잡한 문제를 단순한 문제들의 조합으로 처리할 수 있습니다.

이 때문에 논리 문제나 계산 문제, 다단계 추론이 필요한 질문에서 CoT 프롬프트는 정확도를 크게 높여줍니다.

다만 CoT 역시 한계가 있습니다. 사고의 초반 단계에서 잘못된 가정을 하면 이후의 모든 단계가 틀어질 수 있고, 하나의 사고 경로만 따라가기 때문에 다른 가능성을 탐색하지 못합니다.

즉, CoT는 “한 가지 길을 차분히 끝까지 가는 방식”이라고 볼 수 있습니다. 이 한계를 보완하기 위해 등장한 개념이 ToT입니다.

Tree of Thoughts : 여러 갈래로 생각하게 만들기

ToT는 CoT와 달리 사고를 하나의 선이 아니라 여러 갈래로 분기되는 구조로 확장합니다.

AI에게 “이 문제를 해결할 수 있는 여러 방법을 떠올려보고, 그중 가장 좋아 보이는 방향을 선택해줘”라고 요청하는 셈입니다.

사람도 중요한 결정을 할 때 하나의 방법만 떠올리지 않습니다. 방법 A로 가면 어떤 결과가 나올지, 방법 B는 리스크가 크지 않을지, 방법 C는 시간이 너무 오래 걸리지는 않을지를 비교합니다. ToT는 AI에게도 이런 탐색 과정을 수행하도록 하는 방식입니다.

이 접근법의 장점은 계획 수립이나 전략 문제에 강하다는 점입니다. 단일한 사고 경로에 갇히지 않고 여러 가능성을 검토할 수 있기 때문입니다. 반면 단점도 분명합니다. 생각해야 할 경우의 수가 늘어나면서 계산 비용과 응답 시간이 함께 증가합니다.

그래서 ToT는 모든 서비스에 기본 적용되기보다는, 고난도 문제나 실험적인 영역에서 주로 활용됩니다.

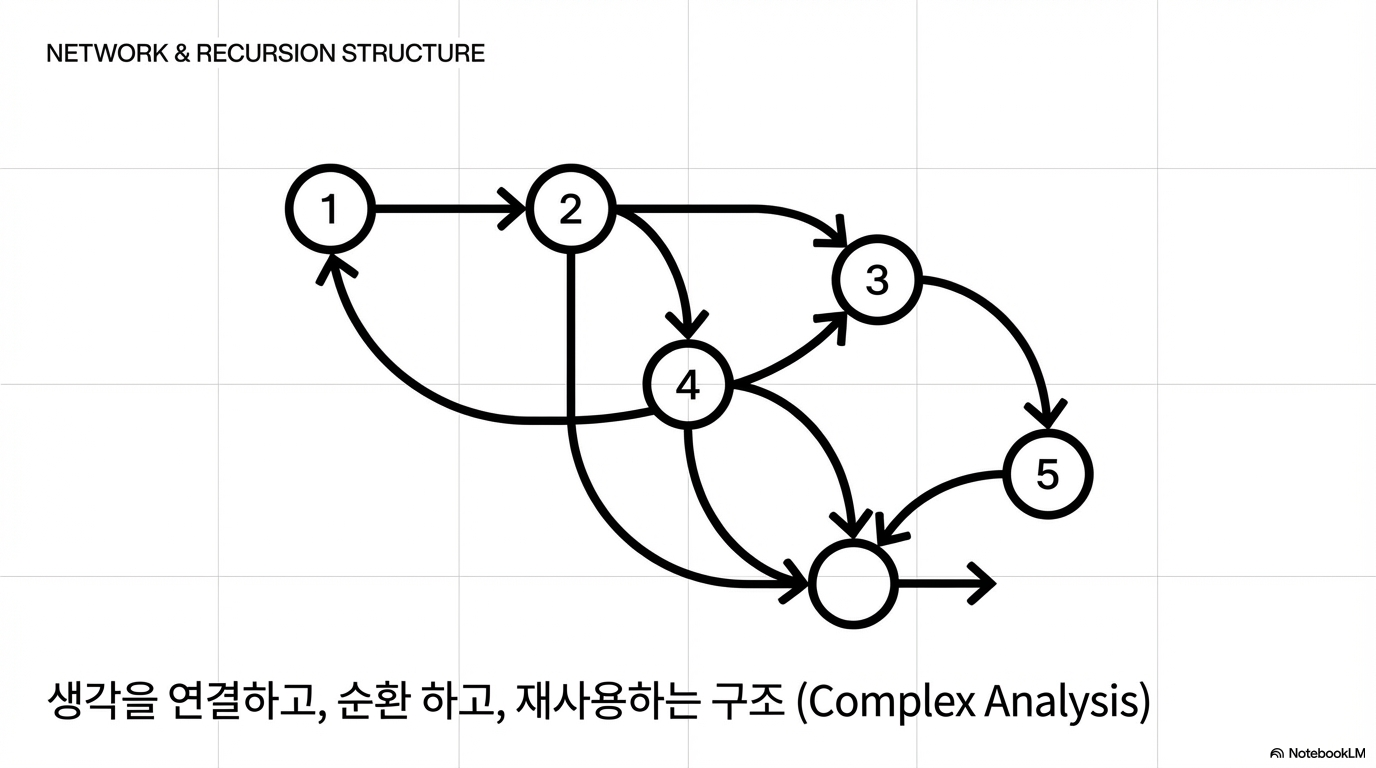

Graph of Thoughts : 생각을 재사용하는 구조

Tree 구조에는 본질적인 한계가 있습니다. 한 번 지나간 가지를 다시 활용하기 어렵다는 점입니다.

이를 보완하기 위해 제안된 개념이 Graph of Thoughts입니다.

GoT에서는 각각의 생각을 노드로 저장하고, 생각들 사이의 관계를 연결선으로 관리합니다.

이 구조를 사용하면 이전에 도출한 생각을 다시 가져오거나, 서로 다른 사고 경로에서 나온 결론을 결합하거나, 중간 결과를 재활용하는 것이 가능해집니다.

이러한 특성 때문에 GoT는 문서가 많고 정보 간의 관계를 엮어야 하는 상황에서 특히 유용합니다.

정책이나 규정 분석, 여러 문서를 비교하는 업무, 복잡한 의사결정을 지원하는 시스템 등이 대표적인 예입니다.

다만 구현 난이도와 비용이 높아, 아직은 연구나 실험 단계에 가까운 접근법이라고 볼 수 있습니다.

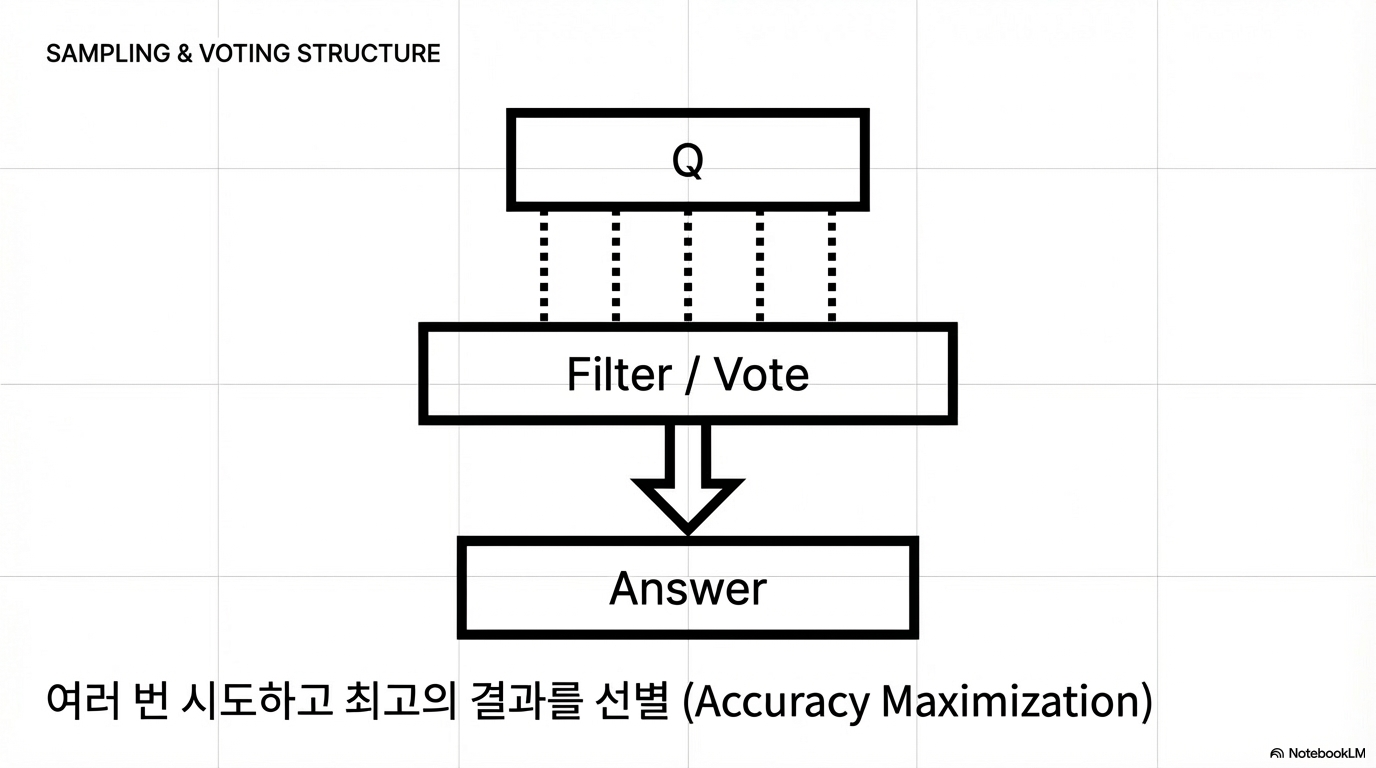

Test-time Scaling : 더 많이 생각하게 하면 더 잘한다

앞서 살펴본 CoT, ToT, GoT가 사고 구조의 차이에 초점을 둔다면, Test-time Scaling은 관점이 조금 다릅니다.

핵심 아이디어는 매우 단순합니다. AI가 답을 내기 전에 더 많이 생각하게 하면 성능이 좋아진다는 것입니다.

여기서 중요한 점은 모델을 다시 학습시키지 않는다는 것입니다. 학습 단계가 아니라, 실제로 답변을 생성하는 추론(test-time) 단계에서 생각의 횟수와 시도를 늘립니다. 이때 자주 사용되는 접근이 Monte Carlo 방식입니다.

Monte Carlo 방식은 여러 번 시도해보고 그중 결과가 좋은 쪽을 선택하는 방법입니다.

AI에게 같은 질문을 여러 번 풀게 하고, 서로 다른 추론 경로를 생성한 뒤, 가장 많이 등장한 답이나 스스로 평가했을 때 점수가 높은 답을 선택하는 식입니다. 이는 “한 번에 완벽한 답을 맞히려 하지 않는다”는 점에서 사람의 사고 방식과도 닮아 있습니다.

이 방식이 최근 주목받는 이유는 모델을 더 키우지 않아도 성능을 끌어올릴 수 있고, 기존의 CoT나 ToT와도 잘 결합되기 때문입니다.

다만 계산 비용이 늘어나고 응답 속도가 느려진다는 단점이 있어, 모든 질문에 적용하기보다는 중요한 판단이나 고가치 질문에 선택적으로 활용되는 방향으로 연구되고 있습니다.

CoT는 한 줄로 차근차근 생각하게 하는 가장 기본적인 방식이며, 쉽고 범용적으로 사용할 수 있습니다.

ToT는 여러 갈래로 사고를 탐색해 계획이나 전략 문제에 강하고, GoT는 생각을 재사용하는 구조로 복잡한 문제에 적합합니다.

Test-time Scaling은 사고의 구조를 바꾸기보다는 생각의 양을 늘려 성능을 끌어올리는 접근이라고 정리할 수 있습니다.

이제 프롬프팅은 AI에게 질문을 예쁘게 던지는 기술이 아닙니다.

어떤 문제에 어떤 사고 구조를 적용할지, 얼마나 생각하게 할지를 설계하는 일에 가깝습니다.

프롬프트 엔지니어링을 넘어, 추론 설계(Reasoning Design)의 영역으로 이동하고 있다고 볼 수 있습니다.

'Tech' 카테고리의 다른 글

| GitHub Action과 Playwright로 경쟁사 소식 공유 자동화 구현하기 (0) | 2025.10.13 |

|---|---|

| SSL 인증서는 왜 로드밸런서에 연결할까? AWS 인프라 흐름 속 HTTPS 적용 지점 이해하기 (0) | 2025.07.15 |

| 공공기관에서는 왜 SaaS를 그대로 쓸 수 없을까? (0) | 2025.05.12 |

| 소프트웨어 개발 계층 구조, 제대로 이해하기 (0) | 2025.03.30 |